目次(1. FOCUSスパコンシステムの概要)

1. FOCUSスパコンシステムの概要

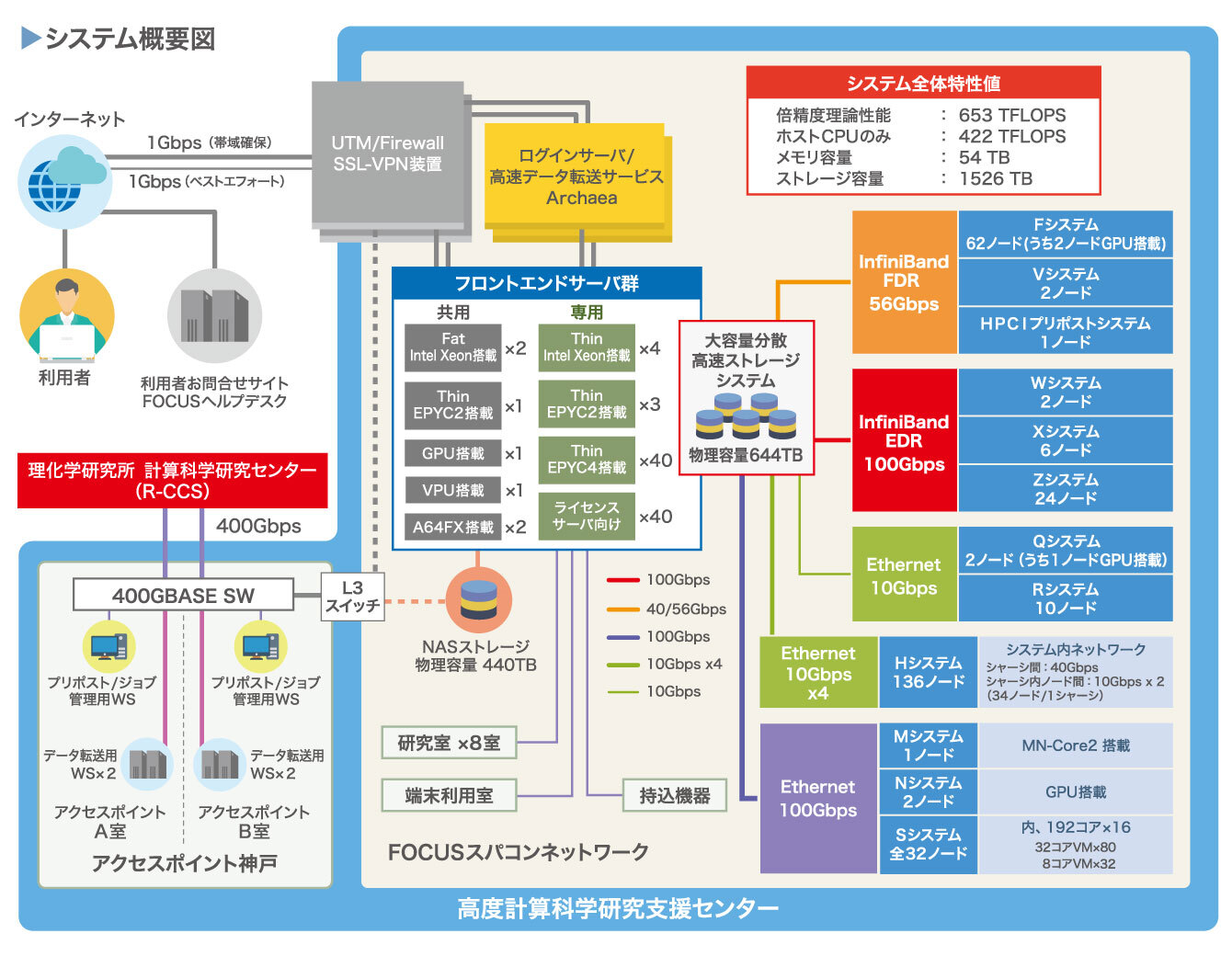

1.1. システム構成

1.1.1. システム概要図

1.1.2. システム構成要素の特徴

FOCUSスパコンシステムを構成する要素について、特徴は以下の通りです。

-

ファイアウォール

インターネットからの不正アクセスを防ぎます。各種ポートを塞いだり一方通行にしたり等のアクセス制御を行います。

-

ウェブサーバシステム

FOCUSスパコンシステムの利用に関する情報を提供します。運用情報や予約状況等を表示します。

-

ログインサーバシステム

インターネットからのSSHプロトコルを使用したログイン接続、ファイル転送の中継を行います。この計算機に一旦ログインしてから再度、フロントエンドサーバシステムにSSHでログイン、ファイル転送を行います。

-

フロントエンドサーバシステム

FOCUSスパコンシステムを利用するための拠点となります。プロジェクト毎の専用のファイルシステムがマウントされ、利用者がログインし、プログラムの開発、ジョブ管理システムの利用、小規模な解析・デバッグ、小規模なプリポスト処理等を行います。

GPU NVIDIA Quadro P1000 を利用できるサーバもあります。共用フロントエンドサーバの利用については 「2.1.1.3.共用フロントエンドサーバへの接続」に記載の【共用フロントエンド利用についての注意点】をご確認ください。

-

Fシステム ノード内並列/ノード間高並列演算兼用

ノード内40コアを利用した共有メモリ並列から、Infiniband-FDR(56Gbps)で接続されたノード間分散メモリ並列、それらを組み合わせたハイブリッド並列にご利用いただけます。

GPU NVIDIA Tesla P100を利用できるノードもあります。 -

Qシステム EPYC3搭載 ノード内高並列指向

EPYC3を搭載しており、ノード内64コアを利用した共有メモリ並列にご利用いただけます。

GPU NVIDIA A100を利用できるノードもあります。 -

Rシステム EPYC3搭載 ノード内/ノード間高並列演算兼用

EPYC3を搭載しており、ノード内32コアを利用した共有メモリ並列から、10 Gigabit Ethernet (10Gbps) で接続されたノード間分散メモリ並列、それらを組み合わせたハイブリッド並列にご利用いただけます。

-

Sシステム EPYC4搭載 ノード内/ノード間高並列演算兼用

物理ノード(192コア)もしくはいくつかの仮想マシン(VM)に分割して提供しています。

物理ノード間は 100 Gigabit Ethernet (100Gbps) で接続されています。 -

Vシステム ベクトルエンジン搭載システム

NEC製ベクトルエンジン「SX-Aurora TSUBASA Type 10B」をノード1台あたり1基搭載しております。また、ノード内20コアを利用した共有メモリ並列から、Infiniband-FDR(56Gbps)で接続されたノード間分散メモリ並列、それらを組み合わせたハイブリッド並列にご利用いただけます。

-

Wシステム ベクトルエンジン搭載システム

NEC製ベクトルエンジン「SX-Aurora TSUBASA Type 10B」を8基搭載しております。また、ノード内40コアを利用した共有メモリ並列にご利用いただけます。

-

Xシステム A64FX搭載システム

『富岳』と同じFUJITSU製CPU「A64FX」を搭載しており、ノード内48コアを利用した共有メモリ並列から、Infiniband-EDR (100Gbps) で接続されたノード間分散メモリ並列、それらを組み合わせたハイブリッド並列にご利用いただけます。

-

Zシステム ノード内/ノード間高並列演算兼用

ノード内40コアを利用した共有メモリ並列から、Infiniband-EDR(100Gbps)で接続されたノード間分散メモリ並列、それらを組み合わせたハイブリッド並列にご利用いただけます。

-

HPCIプリポスト プリポスト・大容量メモリ処理用

大容量共有メモリ(1.5TB)を備え、入力データを作成したり、計算した結果をディスク上から大規模共有メモリに読込んで高速にポスト処理を行ったりするためのシステムです。GPU NVIDIA Quadro P4000も2基搭載しております。

-

大容量分散高速ストレージシステム ホーム兼ワーク領域(

/home1)物理容量は369TBです。

/home1としてマウントされています。ユーザのホーム兼ワーク領域として、初期値では課題毎に10GBが無償で割り当てられています。

年度または月単位・10GB単位の有償契約により容量を追加/削減することが可能です。通信帯域は全体で50GB/sです。

1.2. ハードウェア構成

1.2.1. サーバ

-

Fシステム

仕様 構成 製品名(モデル) 富士通 CX2550M2 CPU Intel(R) Xeon(R) E5-2698v4 (2.2GHz) ×2CPU(計40コア)/ノード GPU NVIDIA Tesla P100 16GB ×1/ノード (2 ノードのみ搭載) メモリ 128 GB/ノード インターフェース Infiniband-FDR(56Gbps)×1/ノード ターボブースト ON -

Qシステム

仕様 構成 製品名(モデル) DELL PowerEdge R6515 CPU AMD EPYC 7713 (2.0GHz) ×1CPU(計64コア)/ノード メモリ 512 GiB/ノード インターフェース 10 Gigabit Ethernet(10Gpbs)×1/ノード -

Qシステム(GPU搭載)

仕様 構成 製品名(モデル) DELL PowerEdge R7525 CPU AMD EPYC 7543 (2.8GHz) ×2CPU(計64コア)/ノード GPU NVIDIA A100 80GB PCIe ×2/ノード (1 ノードのみ搭載) メモリ 512 GiB/ノード インターフェース 10 Gigabit Ethernet(10Gpbs)×1/ノード -

Rシステム

仕様 構成 製品名(モデル) DELL PowerEdge R6515 CPU AMD EPYC 7543P (2.8GHz) ×1CPU(計32コア)/ノード メモリ 256 GiB/ノード インターフェース 10 Gigabit Ethernet(10Gpbs)×1/ノード -

Sシステム

※ 以下の仕様のサーバの一部を仮想マシンまたは物理マシンとして提供

仕様 構成 CPU AMD EPYC 9654 (2.4GHz) ×2CPU(計192コア)/ノード メモリ 768 GiB/ノード インターフェース 100 Gigabit Ethernet ×2/ノード -

Vシステム

仕様 構成 製品名(モデル) NEC SX-Aurora TSUBASA A300-2 CPU Intel(R) Xeon(R) Gold6148 (2.4GHz) ×1CPU(計20コア)/ノード ベクトルエンジン SX-Aurora TSUBASA Type10B (48GB) ×1/ノード メモリ 96 GB/ノード インターフェース Infiniband-FDR(56Gbps)×1/ノード ターボブースト ON -

Wシステム

仕様 構成 製品名(モデル) NEC SX-Aurora TSUBASA A300-8 CPU Intel(R) Xeon(R) Gold6148 (2.4GHz) ×2CPU(計40コア)/ノード ベクトルエンジン SX-Aurora TSUBASA Type10B (48GB) ×8/ノード メモリ 192 GB/ノード インターフェース Infiniband-EDR (100Gbps) ×1/ノード ターボブースト ON -

Xシステム

仕様 構成 製品名(モデル) 富士通 PRIMEHPC FX700 CPU FUJITSU A64FX (1.8GHz) ×1CPU(計48コア)/ノード メモリ 32 GB/ノード インターフェース Infiniband-EDR (100Gbps) ×1/ノード -

Zシステム

仕様 構成 製品名(モデル) 富士通 CX2560M5 CPU Intel(R) Xeon(R) Gold 6230 (2.10GHz) x2CPU(計40コア)/ノード メモリ 192 GB/ノード インターフェース Infiniband-EDR (100Gbps) ×1/ノード -

HPCIプリポスト

仕様 構成 製品名(モデル) 富士通 RX2540 M4 CPU Intel(R) Xeon(R) Silver 4112 (2.60GHz) ×2CPU(計8 コア)/ノード GPU NVIDIA Quadro P4000 x2/ノード メモリ 1,536 GB/ノード インターフェース Infiniband-FDR(56Gbps)×1/ノード ターボブースト ON -

共用フロントエンドサーバ

仕様 構成 製品名(モデル) Lenovo ThinkSystem SR630 CPU Intel(R) Xeon(R) Silver 4112 (2.60GHz) ×1CPU(計4 コア)/ノード メモリ 128 GB/ノード -

GPU 搭載共用フロントエンド

仕様 構成 製品名(モデル) uniV UNI-i7GH CPU Intel(R) Core i7 7700K (4.2GHz) ×1CPU(計4 コア)/ノード GPU NVIDIA Quadro P1000 4GB ×1/ノード メモリ 64 GB/ノード -

ベクトルエンジン搭載共用フロントエンド

仕様 構成 製品名(モデル) NEC SX-Aurora TSUBASA A100-1 CPU Intel(R) Xeon Silver 4108(1.8GHz) ×1CPU(計8 コア)/ノード ベクトルエンジン SX-Aurora TSUBASA Type 10C ×1/ノード メモリ 96 GB/ノード -

インターネット高速転送サーバ

ハードウェアをログインサーバと共用します。

-

ログインサーバ

2ノードによる構成です。インターネット高速転送サーバとハードウェアを共用します。

1.3. ソフトウェア構成

1.3.1. オペレーティングシステム(OS)

各システムで採用するオペレーティングシステム(OS)を示します。

Table 1.3.1: オペレーティングシステム(OS)(2024.06時点)

| システム名 | オペレーティングシステム(OS) |

|---|---|

| ログインサーバ | Red Hat Enterprise Linux 8.8 (x86_64) |

| 共用フロントエンドサーバ | Red Hat Enterprise Linux 8.8 (x86_64) |

| GPU 搭載フロントエンドサーバ | Rocky Linux8.10(x86_64) |

| VPU 搭載フロントエンドサーバ | Rocky Linux8.10 (x86_64) |

| 演算ノード (Q,R,V,Wシステム) | Rocky Linux8.10(x86_64) |

| 演算ノード (F,S,Zシステム) | RockyLinux 8.8 (x86_64) | 演算ノード (Xシステム) | CentOS 8.1 (aarch64) |

| HPCIプリポスト | CentOS 7.9 (x86_64) |

1.3.2. ソフトウェア

FOCUSスパコンシステムで利用可能な主なソフトウェアは「動作確認済アプリケーションソフトウェア一覧」に公開しています。

共用領域に「○」があるものは、 /home1/share に導入済みです。導入済みの各ソフトウェアのバージョンはFOCUSスパコンにログインし、

/home1/share/[アーキテクチャ名]/[OSバージョン]/[ベンダー等]/[ソフトウェア名]/ をご確認ください。

また、FOCUSスパコン利用ポータルサイト(要・SSL-VPN接続)に導入情報を随時掲載しています。

1.3.3. アプリケーション

/home1/share/ にインストールしたアプリケーション、数値計算ライブラリ等はご自由に利用ください。FOCUSスパコン上で動作検証済みの商用・有償アプリケーション(Gaussian以外)は、ソフトウェアベンダーからライセンスを取得して頂きましてご利用いただけます。その他フリーソフト等、各利用者がホームディレクトリ配下に独自にインストールしたものが利用可能です。

1.3.3.1.フリーソフトウェア

/home1/share にインストールされているアプリケーション、ライブラリ等は自由に使っていただくことができます。しかしながら当該アプリケーションのご利用にあたってはFOCUSによるサポートはありません。

利用者あるいはグループとしてFOCUSスパコンに未導入のフリーソフトウェアを利用されたい場合は、各アカウントのホームディレクトリやグループ共用のホーム領域( /home1/グループ名/share )に自由にインストールして利用して頂いてかまいません。基本的にFOCUSからのサポートはありません。

1.3.3.2.アプリケーションに関するサポート

FOCUSスパコンに導入した商用ソフトウエアのサポートは、各ソフトウェアベンダーが行っています。

提供されているサポートサービスについては、以下をご参照ください。

-

公益財団法人 計算科学振興財団 > FOCUSスパコン > 利用サポート

「アプリケーションに関するサポート」

1.4. 製品マニュアル

FOCUSスパコン利用ポータルサイトから製品マニュアルを閲覧できます。下記のURLからアクセスしてご覧ください。アクセスにはSSL-VPN接続が必要です。

〔URL〕https://portal.j-focus.jp/focus/app/

▲このページの先頭へ

1.5. ディレクトリ構成

ご利用の形態やソフトウェア、ジョブの特性によってディレクトリを使い分けていただくようお願い致します。

1.5.1.共用フロントエンドサーバ

共用フロントエンドサーバのディレクトリ構成は下表のとおりです。

Table 1.5.1: ディレクトリ構成(共用フロントエンドサーバ)

| ディレクトリパス | 利用目的 |

|---|---|

/home1/グループ名/アカウント名 |

ホームディレクトリ |

/home1/グループ名 |

グループ共用のホーム領域。容量は課題(グループ)あたり200GB (2025/10/1からは初期割当10GB) |

/home1/グループ名/share |

グループで共用するソフトウェアを格納するための領域 | /home1/share |

システム全体で共用するソフトウェアを格納 |

※グループ名は 「g」+“課題ID” 、アカウント名は 「u」+“課題名”+数字4桁 です。

(参考)

/home1: 分散ファイルシステム(書込み性能 全体で50GB/s)

1.5.2.演算ノード

演算ノードのディレクトリ構成は、フロントエンドサーバのディレクトリ構成に加えて下表のとおりです。

Table 1.5.2: ディレクトリ構成(演算ノード)

| ディレクトリパス | 利用目的 |

|---|---|

/work |

スクラッチディレクトリ(演算ノードのローカルディスク) |

各システムの /work で利用できる容量は以下です。

| システム | /work 利用可能量 [GB](おおよそ) |

|---|---|

| F | 870 |

| F (GPU搭載) | 870 |

| Q | 690 |

| Q (GPU搭載) | 690 |

| R | 690 |

| S (8core) | 50 |

| S (32core) | 200 |

| S (192core) | 1000 |

| V | 190 |

| W | 160 |

| X | 400 |

| Z | 930 |

| HPCIプリポスト | 490 |

※演算ノードにログインすることはできません。

(参考)/work の書込み性能は各システムにより異なります。

実測値は「付録A. FOCUSスパコンシステム各種サーバ・ストレージ概要」をご参照ください。